En los últimos meses, la calidad de las imágenes, videos y audios con IA generativa ha mejorado tanto que se ha vuelto cada vez más difícil distinguir entre contenido creado por humanos y contenido artificial. Ya no hablamos de esos vídeos torpes de hace un par de años (por cierto, ¿te has fijado que hablamos de dos años atrás como si hubiera pasado una eternidad? esto da una idea del ritmo de crecimiento de la IA). Hoy, modelos como Sora de OpenAI o Veo de Google DeepMind crean escenas que desafían nuestra percepción de la realidad. El último ejemplo es de menos de hace una semana: el pasado 26 de Agosto, Google lanzó Gemini 2.5 Flash Image (más conocido como Nano Banana). ¿Os acordáis de cuando OpenAI sacó su modelo generador de imágenes a principios de año y se produjo el efecto Ghibli donde todo el mundo quería tener su propia imagen generada al estilo del estudio de animación Studio Ghibli?. Estos últimos días está pasando algo parecido: la red se ha inundado de ejemplos espectaculares de lo que Nano Banana es capaz de hacer.

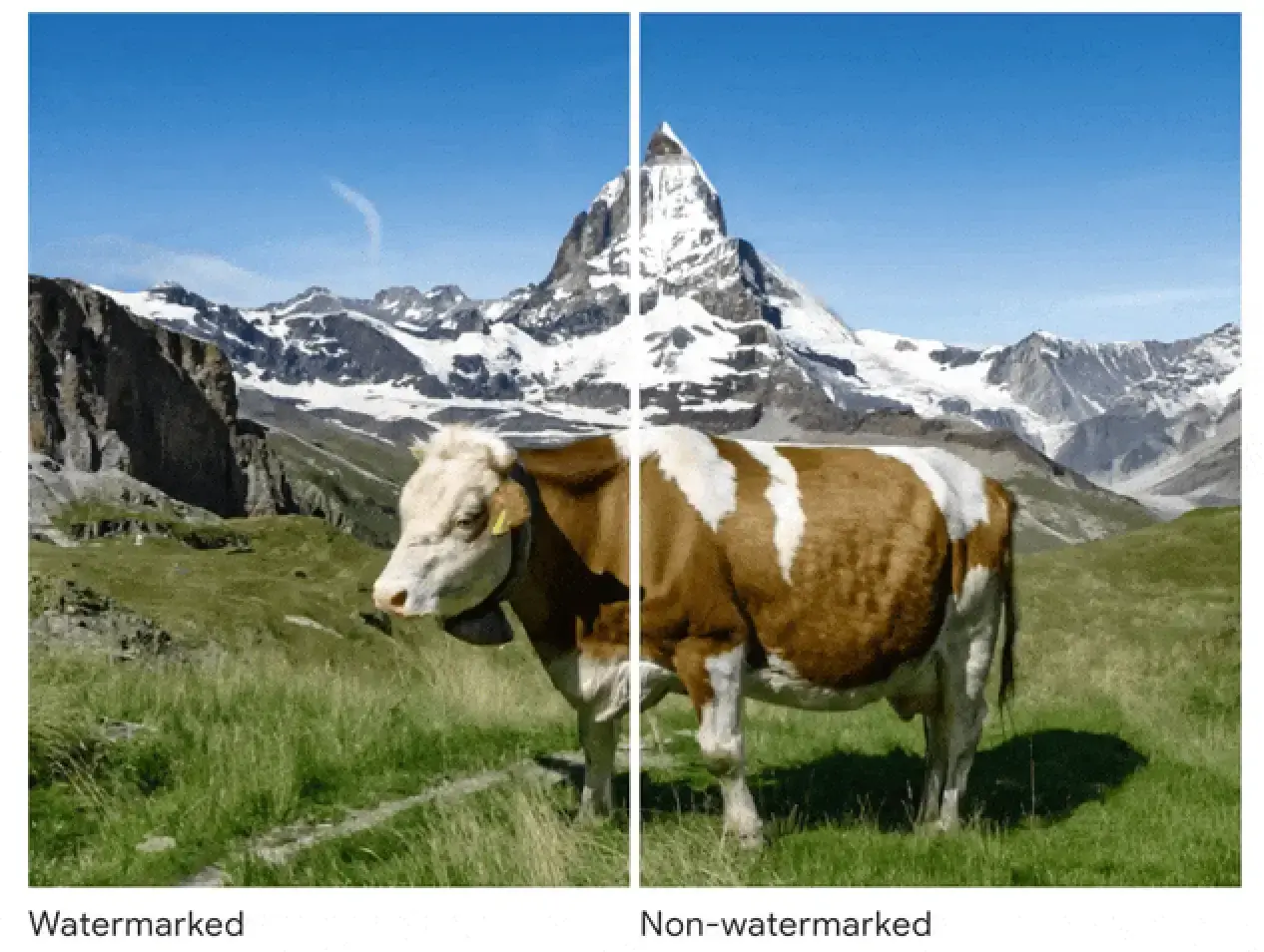

Hace pocos días me topé con un test: una imagen real junto a una generada por IA. Fui incapaz de diferenciarlas. Te dejo el reto a ti. ¿Sabrías decir cuál es cuál?

Esta anécdota esconde una pregunta fundamental: si nuestros ojos ya no son un juez fiable, ¿cómo vamos a confiar en el contenido que vemos? ¿Estamos destinados a dudar de todo?

Por suerte, algunas de las mentes más brillantes del planeta ya están trabajando en la respuesta.

SynthID: la huella digital invisible

Ante el riesgo de un futuro lleno de deepfakes y desinformación, la solución no es frenar la tecnología, sino hacerla más transparente. Y aquí es donde entra SynthID.

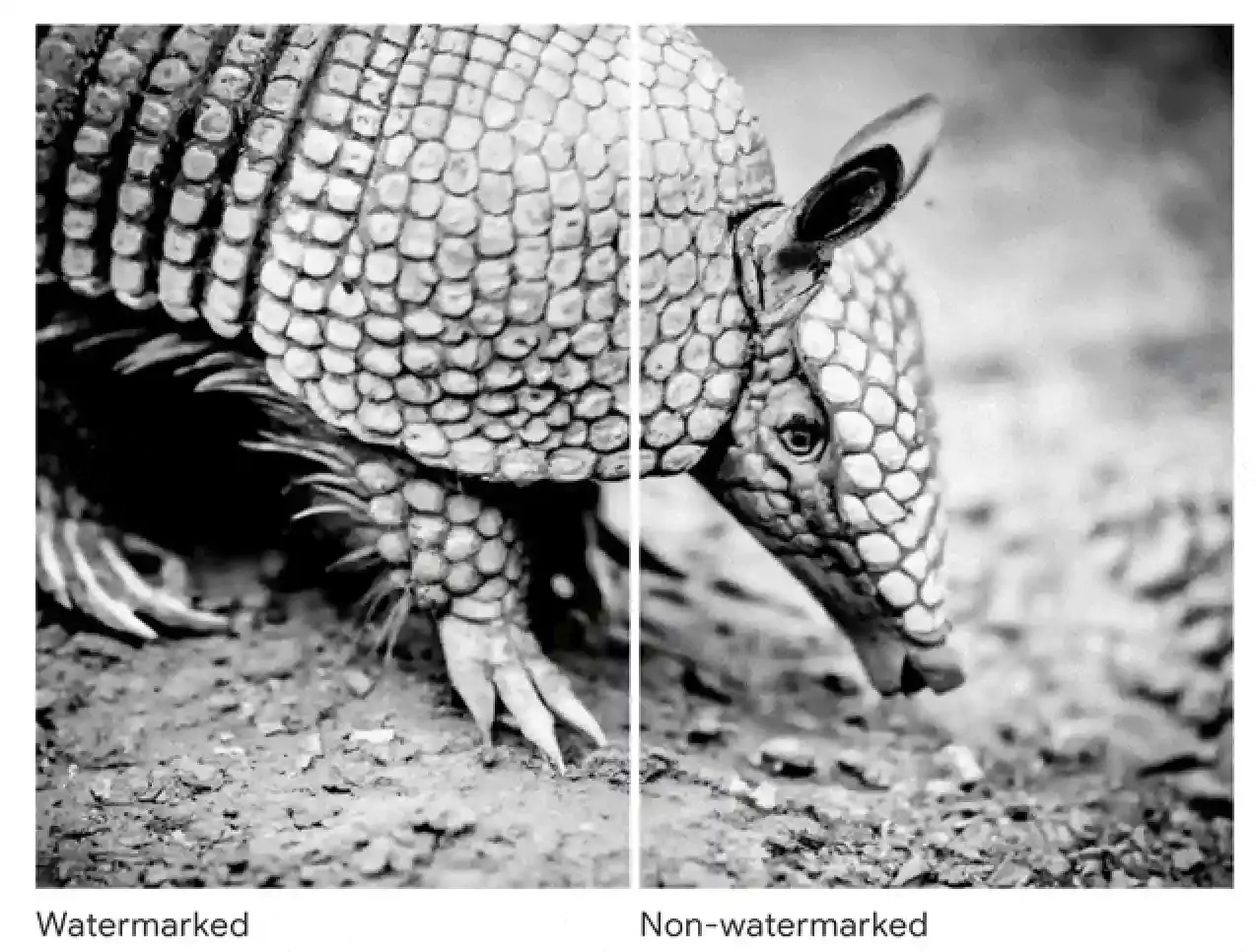

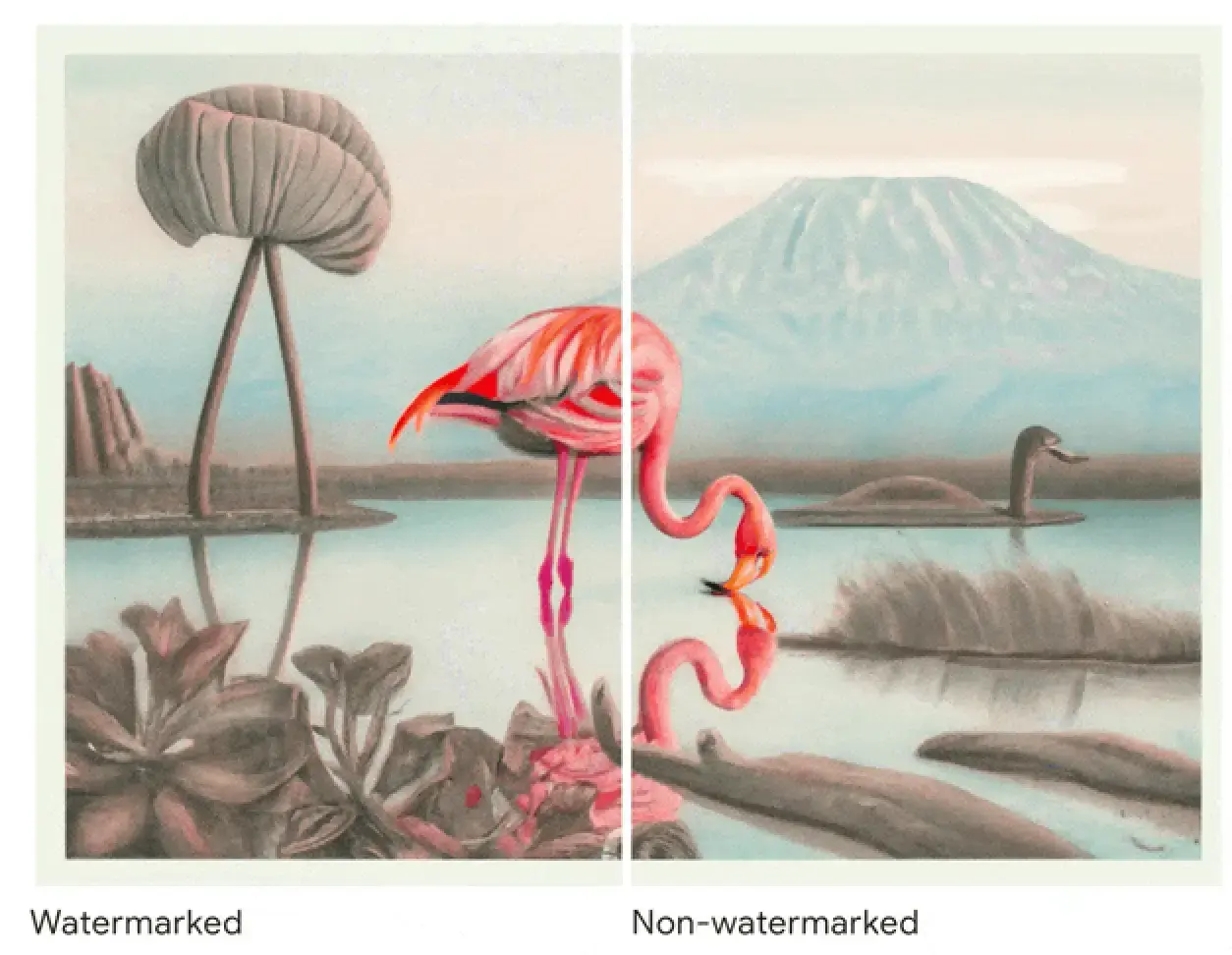

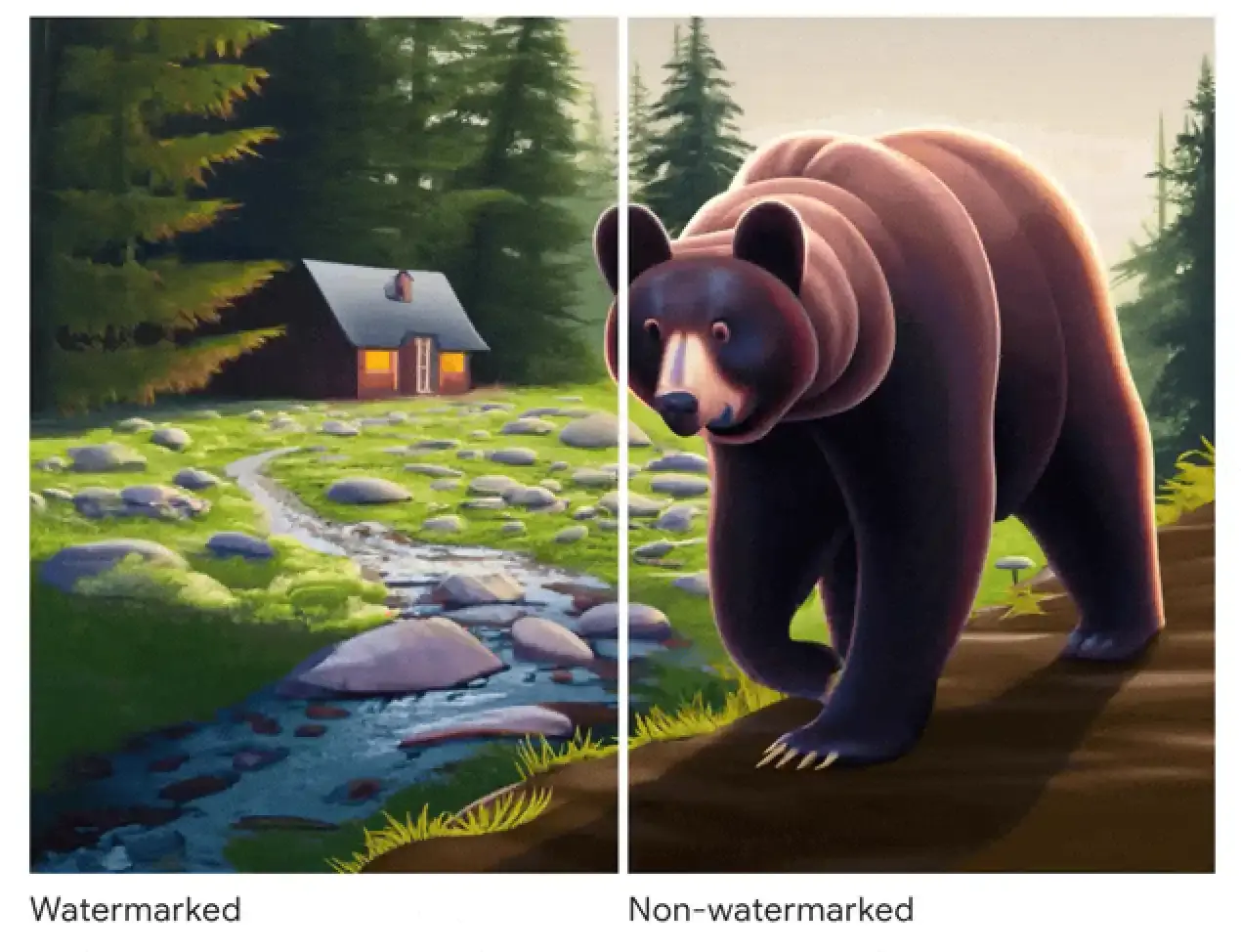

Piensa en SynthID como una etiqueta digital para el contenido generado por IA. Es una marca de agua (o watermark) que se incrusta directamente en una imagen, un audio o un texto en el momento de su creación por IA. La clave es que esta marca es completamente imperceptible para los humanos, pero fácilmente detectable por una herramienta específica.

Esto va mucho más allá de hacer el truquito de poner algo de texto invisible, añadir una etiqueta a los metadatos que se podrá eliminar o un logo visible que se pueda recortar. SynthID es una firma tejida en la propia estructura del contenido, una solución robusta y con una gran solidez científica detrás.

¿Y quién está detrás de esta idea?

Para entender la importancia de SynthID, hay que conocer a sus creadores: Google DeepMind.

No estamos hablando de una startup cualquiera. Tiene sus orígenes en 2010, cuando Demis Hassabis, Mustafa Suleyman y Shane Legg crearon Deepmind. En 2014 sería adquirida por Google y fusionada con Google AI para conformar Google DeepMind. En la actualidad, es uno de los laboratorios de investigación en IA más importantes del mundo, responsable de hitos que han cambiado la ciencia, como AlphaFold, un modelo que resolvió el problema del plegamiento de proteínas y que le valió a su CEO, Demis Hassabis, el Premio Nobel de Química en 2024.

Como uno de los principales arquitectos de esta revolución, Google DeepMind entiende que tiene una responsabilidad. No se trata solo de crear herramientas potentes, sino de construir los mecanismos de seguridad y confianza que la sociedad necesita. SynthID no es un producto secundario; es su respuesta a la pregunta: “¿Cómo nos aseguramos de que esta tecnología se use de forma responsable?”.

¿Cómo funciona esta “magia” invisible?

SynthID se basa en la esteganografía, el arte de ocultar mensajes a plena vista. La forma en que lo hace varía según el tipo de contenido:

En imágenes y vídeos: un poco de maquillaje a los píxeles

En una imagen, SynthID no añade nada visible. En su lugar, modifica sutilmente el color de algunos píxeles, tejiendo un patrón invisible en el propio tapiz de la imagen. Este patrón es tan sutil que sobrevive a ediciones comunes como recortes, compresiones o filtros de color. En los vídeos, este patrón se distribuye a lo largo de todos los fotogramas.

En audio: la nota que solo un algoritmo puede oír

Para el audio, no se alteran las notas en sí, sino que SynthID modifica el espectro de frecuencias en algunas frecuencias inaudibles para el oído humano. Algo así como si un músico añadiera a una canción una nota tan aguda que solo un perro (o un algoritmo) pudiera oírla. La melodía que escuchamos no cambia, pero la “nota secreta” sigue ahí, resistiendo a compresiones o cambios de velocidad. También pueden introducir pequeños cambios en notas de mayor o menor volumen, que son las que pueden esconder mejor estas modificaciones.

En texto: el “tic” del escritor

El texto es el mayor desafío. No hay millones de píxeles o frecuencias que modificar sutilmente. La solución, publicada en la prestigiosa revista Nature, es brillante. En lugar de alterar el texto después de crearlo, SynthID modifica el proceso de generación.

Es como si la IA tuviera un “tic” de escritor: una preferencia casi imperceptible por usar ciertos sinónimos o estructuras gramaticales. Para un humano, el texto es perfectamente natural. Pero si analizas miles de palabras, emerge un patrón, una firma estadística que delata su origen. Puede parecer sencillo, pero hay todo un desarrollo matemático detrás para lograr que este “tic” no afecte la calidad del texto ni su coherencia. En resumen, cuando Gemini te genera un texto, te está colocando ciertas palabras que por su propio modelo y probabilidad estadística no deberían estar ahí de forma tan frecuente, pero ha alterado su propia estadística para dejar un rastro de migas que luego sabrá desvelar.

Vale, es invisible… ¿entonces cómo se detecta?

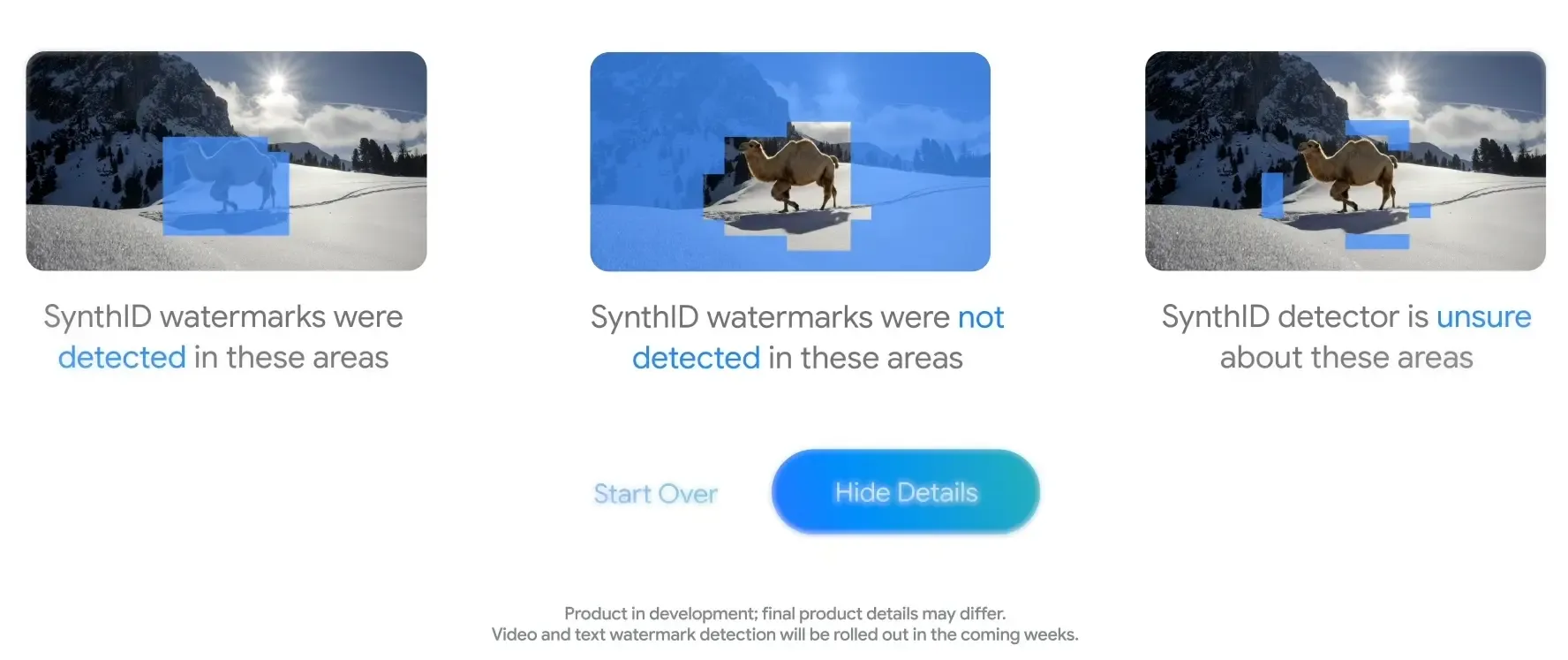

Google Deepmind ha creado una herramienta, SynthID Detector, diseñada para buscar estas huellas. El funcionamiento es simple (la tecnología detrás, no tanto): subes un archivo (imagen, audio o texto) y la herramienta lo escanea.

El resultado no es un simple “Sí” o “No”. Te muestra tres niveles de confianza:

- Detectado: La marca de agua está presente.

- No detectado: No se encontró la marca de agua.

- Posiblemente detectado: La marca podría estar ahí, pero la señal es débil (quizás por una edición muy agresiva).

Además, en las imágenes, te resalta las áreas donde la marca es más fuerte. Esto es útil para identificar si una imagen real ha sido modificada parcialmente con IA.

La carrera por la transparencia: SynthID no está solo

La buena noticia es que Google DeepMind no es el único jugador en esta carrera. La idea de un estándar de transparencia está ganando fuerza en toda la industria.

- Meta (la empresa matriz de Facebook e Instagram) ya está trabajando en su propia tecnología, llamada “Stable Signature”, con un enfoque similar para sus modelos de IA generativa.

- Microsoft, OpenAI y otras grandes empresas también están investigando activamente soluciones de watermarking, aunque no hay tanto contenido disponible al público como los artículos de Google y Meta.

Esto no es una batalla por ver quién tiene la mejor tecnología, sino un esfuerzo colectivo por construir un ecosistema digital más fiable. El objetivo es que, en el futuro, la mayoría del contenido generado por IA lleve algún tipo de “etiqueta” digital, dándonos a todos más control sobre la información que consumimos.

En realidad no importa si una imagen tiene una huella y otra. No hay problema en escanear la pieza de contenido en busca de las decenas de marcas de agua que pueda tener, cada una creada por una compañía. Al igual que pasa con los billetes, cada banco central tiene su manera de crear marcas que permitan detectar sus billetes falsificados, aunque los billetes, o el marcado, sean distintos.

Las limitaciones: un escudo, no una barrera infalible

Como toda tecnología, SynthID tiene sus límites. Sus propios creadores son transparentes al respecto:

- No es 100% efectivo: Por ejemplo, en texto, los creadores reportan que aunque esta huella digital se comporta relativamente bien en la mayoría de situaciones, flaquea un poco en piezas factuales, donde hay menos lugar al retoque de la probabilidad de aparición de ciertas palabras.

- Depende de la adopción: SynthID solo funciona si los creadores de modelos de IA deciden implementarlo. Un modelo de código abierto sin esta función podría generar contenido indetectable. Aunque en este sentido, ya se están generando colaboraciones, como la que anunció este mismo año con NVIDIA, donde acordaron que su modelo Cosmos de NVIDIA introduciría SynthID para sus creaciones.

- Las modificaciones extremas ayudan a ocultarlo: Si un contenido marcado se edita de forma muy agresiva, la señal de la marca de agua puede debilitarse hasta volverse indetectable.

Mi reflexión: Transparencia, no restricción

Personalmente, veo SynthID como un paso gigante en la dirección correcta. El objetivo no es demonizar el contenido creado con IA, sino empoderarnos con información. Es como saber si estás hablando con un chatbot o con una persona en atención al cliente: ninguna opción es inherentemente mala, pero saber con quién interactúas te permite ajustar tus expectativas y tu confianza.

Estamos entrando en una era donde la alfabetización digital ya no consiste solo en saber usar la tecnología, sino en saber cuestionarla. Herramientas como SynthID (o Stable Signature, o las que salgan) puede que no sean aún son la solución definitiva, pero son los cimientos de un internet más honesto.

Respuesta al test del inicio

¿Aún con la duda? La imagen de la izquierda es una fotografía real tomada de Pinterest, mientras que la de la derecha está creada por IA. De hecho, es un fotograma de un video generado con Veo 3, de Google Deepmind. Si no fuiste capaz de distinguirlas, no te preocupes, precisamente por eso necesitamos herramientas como SynthID. Además, si le pasaras el SynthID Detector a ambas, ¡verías que la de la derecha tiene insertado esa huella digital!